Seedance 2.0: Guía de Producción Real, Consistencia y el Hack del Grid 3×3 (2026)

La industria del cine entró en pánico cuando ByteDance liberó Seedance 2.0. No fue por su capacidad de generar vídeo, sino por su precisión quirúrgica. Tras invertir 5.000 créditos probando sus límites en YouArt, he comprobado que estamos ante un cambio de paradigma: la IA ha dejado de ser un generador de «clips bonitos» para convertirse en una herramienta de producción visual con físicas coherentes.

El problema es que la potencia viene con cadenas. Los filtros de copyright son agresivos y los costes por clip de 15 segundos (hasta 600 créditos) no permiten errores. En este artículo te enseño el flujo de trabajo exacto que utilicé en arcaartificial.com para transformar una foto mía en un clip militar cinematográfico y cómo logré que el modelo hablara español con una sincronización labial que deja a Veo 3 en evidencia.

La Fórmula Maestra: Estructura de Prompting en 7 Pasos

Para obtener resultados profesionales en Seedance 2.0, no puedes escribir de forma ambigua. Necesitas una estructura semántica que el modelo entienda perfectamente. Esta es la fórmula que refiné tras docenas de fallos:

- Identidad: Define quién o qué es el protagonista (ej. «Soldado militar con rasgos de [Nombre]»).

- Escena Concreta: Dónde ocurre la acción (ej. «Campo de batalla urbano, escombros, humo denso»).

- Acción Principal: Qué está pasando (ej. «Corriendo hacia la cámara mientras dispara»).

- Progresión: Cómo evoluciona la escena (inicio, desarrollo y cierre sin cortes).

- Cámara Dirigida: Especifica el movimiento (ej. «Giro de 180 grados, seguimiento dinámico»).

- Físicas Realistas: Cómo reacciona el entorno (ej. «Explosiones con partículas de polvo»).

- Restricciones: Lo que NO quieres (ej. «Sin deformaciones, mantener consistencia facial»).

Prompt de ejemplo (Caso Militar):

[Secuencia bélica cinematográfica, el mismo hombre que en la imagen de referencia; mantener en todo momento la identidad facial exacta, la barba, las proporciones y la coherencia del uniforme

ESCENA:

Trinchera de combate realista, barro, sacos de arena, cajas militares, humo y explosiones en la distancia

ACCIÓN (CONTINUA, SIN CORTES):

El hombre comienza de pie, inmóvil, durante un breve instante; luego, de repente, empieza a correr hacia delante por la trinchera

Mientras corre, las explosiones cercanas golpean el suelo, la tierra y los escombros vuelan a su alrededor, otros soldados se mueven y reaccionan en el fondo

Sale de la trinchera hacia una zona más abierta del campo de batalla, y sigue corriendo hacia delante con urgencia

CÁMARA:

Empezar con un plano medio frontal (cámara de frente a él)

La cámara se desplaza hacia atrás mientras él corre hacia ella

A continuación, la cámara realiza una suave rotación de 180 grados a su alrededor (lado izquierdo o derecho), pasando de la vista frontal a la vista trasera

Tras la rotación, la cámara se queda detrás de él, siguiendo su movimiento hacia delante (toma de seguimiento desde atrás)

Fuerte paralaje con el entorno (soldados, sacos de arena, tanques)

MOVIMIENTO:

Movimiento natural al correr, peso realista, equipo rebotando ligeramente, sin cámara lenta

ENTORNO:

Atmósfera densa de campo de batalla, explosiones continuas, columnas de humo, escombros volando, tanques en la distancia, soldados moviéndose de forma dinámica pero no caótica

ILUMINACIÓN:

Iluminación de guerra nublada con destellos de explosiones que iluminan la escena

OBJETIVO:

Objetivo cinematográfico de 35 mm, ligero desenfoque de movimiento en los movimientos rápidos, sujeto siempre reconocible]

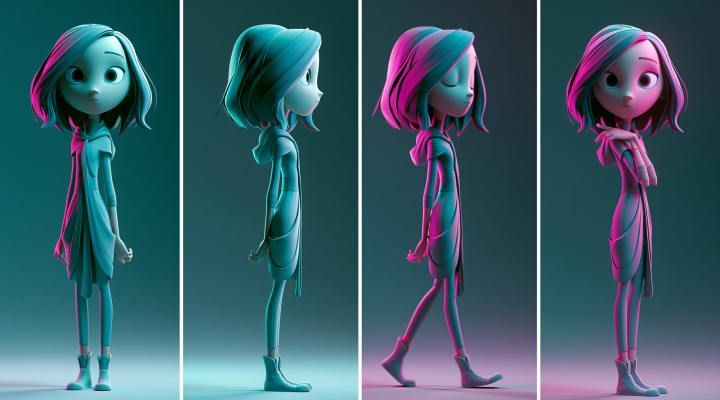

El Hack del «Grid 3×3»: Cómo saltar los filtros de copyright

Uno de los mayores obstáculos de Seedance 2.0 es su filtro de seguridad. Si intentas usar una foto de una persona real o una marca, el sistema suele bloquear la generación. Para solucionar esto, diseñé este flujo de trabajo:

- Generación de Referencia Múltiple: Utiliza Gemini para crear un Grid 3×3 (una cuadrícula de 9 imágenes) que muestre tu personaje o producto desde diferentes ángulos.

- Engaño Semántico: Al subir este grid como imagen de referencia en el nodo de Omni Reference, el modelo no detecta una «identidad protegida», sino un «asset técnico de múltiples vistas».

- Prompt en Chino: Traduce tu prompt final con DeepL al chino. Seedance 2.0 es nativo de ByteDance y su interpretación mejora un 40% cuando recibe instrucciones en su idioma original.

Resultado Real: Logré generar un comercial vertical de un motero en un bar manteniendo mi consistencia facial al 100%, algo que fallaba constantemente usando una sola foto inicial.

Seedance 2.0 vs Kling AI vs Veo 3: El veredicto técnico

He enfrentado a los tres titanes en dos escenarios críticos: la transformación de un coche en robot y el lip-sync en español.

| Característica | Seedance 2.0 | Kling AI (1.5) | Google Veo 3 |

|---|---|---|---|

| Lip-Sync (Español) | Excelente. Fluidez natural. | Bueno, requiere prompts cortos. | Regular. Pausas artificiales. |

| Movimiento Cámara | Bestial. Control total. | Muy fluido, giros limitados. | Cinematográfico, pero lento. |

| Costo/Esfuerzo | Alto (600 créditos/15s). | Moderado. | Beta cerrada. |

🎬 Mira el workflow completo y la comparativa real en vídeo:

Preguntas Frecuentes (FAQ)

1. ¿Cómo se logra la consistencia de personaje real en Seedance 2.0?

Debes usar el modo Omni Reference y, preferiblemente, fotos con fondo blanco. Mi recomendación técnica es usar el Grid 3×3; esto le da al modelo suficiente información espacial para que los rasgos faciales no se deformen durante movimientos bruscos de cámara.

2. ¿Por qué mis diálogos en español fallan en Seedance?

El error común es usar párrafos largos. Seedance 2.0 funciona mejor con frases cortas o medianas con puntuación marcada. Un truco de Arcademia es usar el formato: Personaje A: [Frase corta]. Personaje B: [Respuesta corta] para asegurar una sincronización milimétrica.

3. ¿Es mejor usar prompts en español o en chino?

Aunque Seedance entiende español, su motor principal es chino. Los movimientos de cámara complejos y las físicas se ejecutan con mucha más fidelidad cuando el prompt se traduce al chino mediante DeepL. El español déjalo exclusivamente para el bloque de diálogos.

4. ¿Dónde puedo usar Seedance 2.0 desde Europa?

Actualmente, plataformas como YouArt, Dreaminia y Martini AI ofrecen acceso a la API de Seedance 2.0. Personalmente, realicé mis pruebas en YouArt, donde los planes comienzan desde los $10 para unos 1.000 créditos aproximadamente.

Veredicto del Capitán

Seedance 2.0 no es para jugar; es para producir. La combinación de su control de cámara y el poder de Omni Reference lo sitúa un peldaño por encima de la competencia si sabes cómo manejar los nodos y saltar los filtros. Si quieres ver el tutorial completo donde muestro estos casos reales, te espero en mi canal de YouTube.

Para dominar workflows profesionales y elevar tu producción visual, únete a nuestra comunidad premium en Arcademia. Es hora de dejar de probar herramientas y empezar a crear resultados.

Si quieres que te ayudemos a llevar esto a nivel producción (consistencia de personaje, dirección visual, workflows que escalan y piezas publicables), en Arca Artificial hacemos producción audiovisual con IA y consultoría 1:1.

Además, súmate a la comunidad de Telegram y revisa el resto del contenido del proyecto: vamos compartiendo recursos, pruebas reales y workflows para que pases de “probar herramientas” a publicar con intención.